Как нейросети превращают фейки в инструмент массового влияния

Фото: magnific.com

Как дипфейки, фальшивые заявления и конспирологические теории трансформируют информационное пространство и почему критическое мышление становится ключевым навыком цифровой эпохи — в материале.

Еще несколько лет назад поддельные новости можно было сравнительно легко распознать по низкому качеству изображения, неудачному монтажу или очевидным несоответствиям. Сегодня ситуация изменилась: искусственный интеллект способен создавать реалистичные видео, синтезированные голоса, «новостные репортажи» несуществующих телеканалов и изображения событий, которых никогда не происходило.

В результате фейковый контент все глубже интегрируется в информационный поток социальных сетей и нередко воспринимается как часть реальной новостной повестки. Он становится инструментом эмоционального воздействия и манипуляции общественным вниманием, особенно в периоды кризисов, конфликтов и чрезвычайных ситуаций, когда аудитория наиболее восприимчива к тревожным сообщениям.

В этих условиях цифровая гигиена приобретает значение базового навыка безопасности. Пользователям социальных сетей приходится фактически учиться заново отличать достоверную информацию от синтетического или искаженного контента, созданного для максимального вирусного эффекта.

Дезинформация в эпоху ИИ

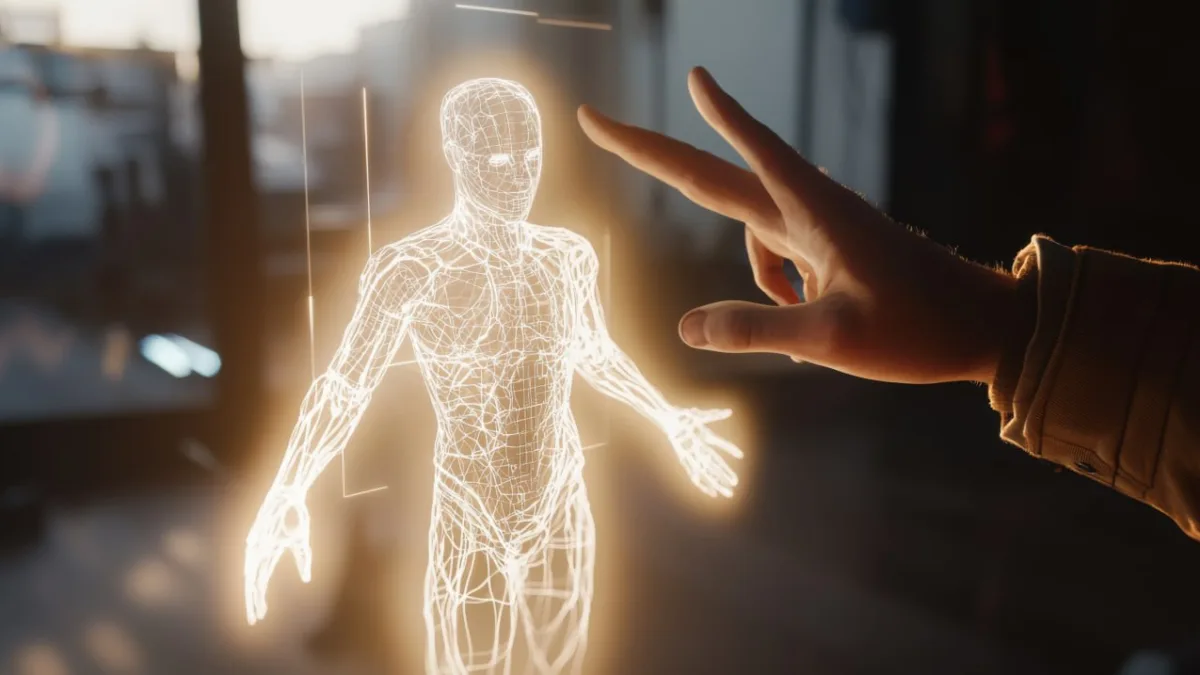

Одним из недавних примеров стали видеоролики, распространявшиеся в TikTok, Instagram и мессенджерах, в которых утверждалось, что после ударов по объектам на Ближнем Востоке якобы произошло резкое изменение климата. Авторы публикаций связывали это с «климатическим оружием», аномальными погодными явлениями и скрываемыми последствиями.

При этом пользователи социальных сетей, включая аудиторию Казахстана, активно распространяли данный нарратив, что во многом объясняется его эмоциональной подачей и вирусным потенциалом.

Однако проверка команды NoFake.kz показала, что подтвержденных первоисточников у этих сообщений нет. В распространяемых материалах отсутствуют точные даты, геолокации и ссылки на официальные данные. Используются фрагменты разных видео, тревожная музыка и эмоциональные подписи, не связанные с реальными событиями.

Между тем международные СМИ действительно сообщали об ударах по военной инфраструктуре в регионе Ближнего Востока. Однако сведения о разрушениях объектов, способных повлиять на климатические процессы, отсутствуют. Ни метеорологические службы, ни научные организации подобных последствий не подтверждали.

«Высокоскоростная» дезинформация

Масштабы распространения контента, созданного с использованием искусственного интеллекта, выходят далеко за пределы отдельных вирусных публикаций. Во время крупных международных кризисов нейросетевой контент начинает функционировать как инструмент информационного влияния, а скорость его распространения зачастую опережает возможности фактчекеров и журналистов.

Особенно заметно это проявляется в периоды вооруженных конфликтов, когда социальные сети заполняются сгенерированными изображениями, постановочными видео и эмоциональными роликами, выдаваемыми за реальные события.

«Дезинформация, созданная с помощью ИИ, распространяется с беспрецедентной скоростью из множества источников. С самого начала конфликта на Ближнем Востоке подобные материалы публиковались представителями разных сторон», — сообщает Associated Press.

По данным агентства, Институт стратегического диалога, занимающийся мониторингом дезинформации и онлайн-экстремизма, выявил ряд аккаунтов, систематически распространявших AI-контент. Совокупный охват таких публикаций превысил миллиард просмотров с начала кризисного периода.

Отмечается, что часть этих аккаунтов имела верификацию, что дополнительно повышало уровень доверия аудитории.

Таким образом, реальные события все чаще смешиваются с интерпретациями, домыслами и визуальным контентом, созданным или обработанным нейросетями. Основная цель подобных материалов — это вызвать сильную эмоциональную реакцию: страх, тревогу или ощущение скрытой угрозы.

Эксперты по медиаграмотности подчеркивают, что чем выше эмоциональная нагрузка контента, тем выше вероятность его манипулятивного характера.

Мнение эксперта

«При просмотре любого резонансного видео важно задать себе ряд базовых вопросов: насколько это может быть правдой, кто является источником, есть ли подтверждение в надежных медиа и официальных каналах, и не пытаются ли авторы вызвать у аудитории эмоциональную реакцию и поспешные выводы. Также важно понимать, что у любой информации в интернете, как правило, есть интересанты. За распространением контента могут стоять политические, финансовые, репутационные или идеологические цели. Вопрос “кому это выгодно” часто помогает быстрее распознать возможную манипуляцию», — отмечает эксперт по медиаграмотности портала NoFake.kz Асем Миржекеева.

По ее словам, привычка критически оценивать информацию снижает риск вовлечения пользователей в цепочку распространения дезинформации.

«Чем выше уровень медиаграмотности в обществе, тем сложнее воздействовать на общественное сознание с помощью фейков и манипулятивного контента. Люди, которые умеют анализировать информацию и проверять источники, значительно реже становятся жертвами эмоциональных манипуляций», — добавляет эксперт.

Как распознать контент, созданный нейросетью

Несмотря на то, что современные системы искусственного интеллекта все убедительнее имитируют реальность, у сгенерированного контента по-прежнему сохраняются характерные признаки.

Часто такие материалы выглядят чрезмерно «идеализированными»: с насыщенными цветами, необычным освещением и плавной, почти кинематографичной картинкой, создающей ощущение постановочной сцены.

Другой признак — ошибки в деталях. Это могут быть искаженные объекты, некорректные тени, размытые элементы фона или деформированные части изображения, которые выдают искусственное происхождение контента.

Важным сигналом остается отсутствие первоисточника. Если материал распространяется без указания автора, места и времени съемки или без подтверждения официальных структур, к нему следует относиться с осторожностью.

Манипулятивные публикации часто строятся на усилении эмоционального давления. В них используются формулировки вроде «это скрывают», «СМИ молчат», «срочно распространяйте», которые подталкивают к быстрому и некритичному распространению информации.

Настороженность также должны вызывать случаи, когда «сенсационные» сообщения распространяются исключительно через анонимные каналы или малоизвестные аккаунты без подтверждения со стороны авторитетных источников.

В случае дипфейков можно заметить несоответствия в аудиовизуальном ряде: движения губ не совпадают со звуком, а голос звучит механически, с отсутствием естественных интонаций.